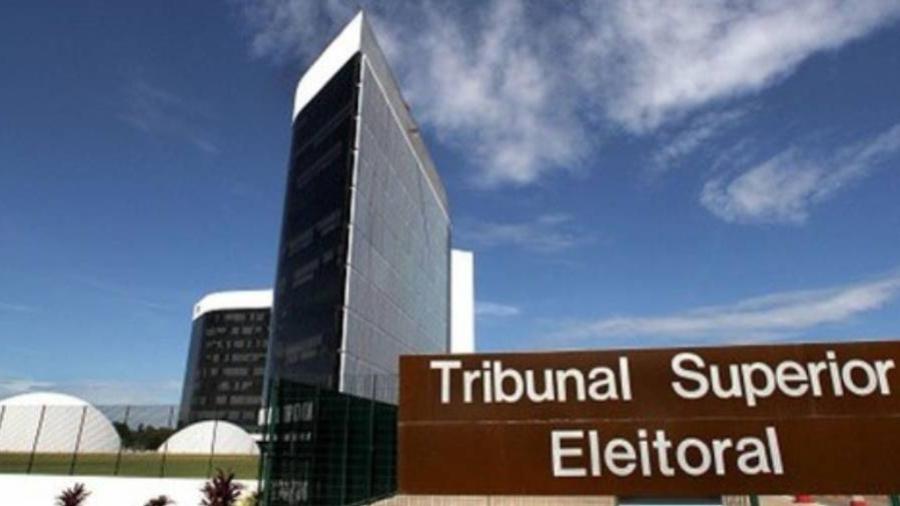

Regulamentação do uso de dados pessoais por forças de segurança é urgente

Se há um ponto sobre qual todos os que participaram das discussões que viabilizaram a aprovação da Lei Geral de Proteção de Dados no parlamento brasileiro concordam é que o país perdeu ao retirar do texto legal os artigos que tratavam de proteção de dados pessoais pelos órgãos de segurança pública. Esse vácuo legal encorajou o surgimento de vários projetos de políticas públicas de segurança baseadas no uso de Inteligência Artificial e reconhecimento facial por todo o país. O mais recente começou a funcionar no último dia 28 de janeiro em São Paulo. E estará a pleno vapor durante o Carnaval.

Isso ficou bem claro durante o debate realizado na última sexta-feira, 31 de janeiro, pelo Data Privacy Brasil para marcar o lançamento do Observatório da Privacidade e Proteção de Dados no Brasil, sobre o qual já escrevi aqui.

"As leis que tratam de proteção de dados pessoais em outros países excepcionalizam a segurança nacional", comentou Bia Barbosa, do coletivo Intervozes, lembrando que esse é um conceito muito diferente do de segurança pública. "Nossa avaliação é de que perdemos ao retirar os artigos da lei, porque naquela altura entendemos ser o único acordo possível para viabilizar a aprovação da lei, como disse o ex-senador Aloysio Nunes em sua fala aqui", completou Bia, após o debate.

Por isso, a atenções agora se voltam para o trabalho da comissão de juristas instituída pelo presidente da Câmara, Rodrigo Maia (DEM-RJ), no fim de novembro, encarregada de elaborar um anteprojeto de lei específica sobre tratamento de dados pessoais na segurança pública, defesa nacional e atividades de investigação de infrações penais. O prazo de 120 dias para a apresentação dos resultados do trabalho termina no início de março, mas pode ser prorrogado.

"A gente precisa dessa lei com urgência. Essa é uma questão de curtíssimo prazo", afirma Bia.

À medida que o debate avança, vale a pena olhar em torno e tornar nosso foco o mais amplo e intercultural possível.

Em todo o mundo, o uso de reconhecimento facial por forças de segurança tem sido repensado. Londres, que foi uma das primeiras cidades do mundo monitorada por câmaras, tem reagido fortemente à adição do reconhecimento facial ao aparato de segurança, por exemplo. Grupos de liberdades civis temem sobre possíveis violações da privacidade. O que mais se ouve é que o uso do reconhecimento facial para fins de vigilância precisa de parâmetros claros.

De acordo com o último rascunho da estratégia de Inteligência Artificial da União Europeia ao qual a Reuters e o EURACTIV tiveram acesso, a Comissão Europeia, que havia anunciado no início de janeiro a possibilidade de proibir o uso de reconhecimento facial em espaços públicos por cinco anos, teria desistido da proibição. Não desistiu, contudo, da criação de 'critérios claros' que balizem a implantação sistemas biométricos em larga escala para fins de identificação dos cidadãos europeus. Segundo o EURACTIV, o documento afirma que será preciso levar em conta salvaguardas para proteger os indivíduos, no caso de dados biométricos serem usados para vigilância em massa. A proposta está atualmente em revisão e a Comissão pretende apresentá-la em 19 de fevereiro.

Mesmo na China, onde o uso do reconhecimento facial parece melhor aceito, a pesquisa "A.I. Among Us: Agency in a World of Cameras and Recognition Systems", publicada recentemente por uma equipe de cientistas sociais financiada pela Intel, revelou resistência ao uso da tecnologia para determinados fins. Quando câmeras de IA foram instaladas na cantina de uma escola chinesa para monitorar a seleção de alimentos dos alunos alguns pais se queixaram.

Esses cientistas passaram três anos realizando pesquisas etnográficas em seis locais onde são utilizadas ferramentas de reconhecimento facial: duas nos EUA (uma escola e uma força policial); e quatro instituições na China, incluindo mais escolas. Segundo os resultados do estudo, fatores culturais tornam o reconhecimento facial mais aceito na China que nos EUA e outros países. Além de se orgulharem da tecnologia criada por eles, curiosamente, alguns cidadãos veem os sistemas de reconhecimento habilitados para IA como sendo mais fáceis e justos de lidar do que os burocratas humanos chineses.

Já entre os americanos, os avanços no desenvolvimento das câmeras de reconhecimento facial e do Machine Learning tendem a provocar "pânico moral". O que explica o fato de muitos estados americanos estarem optando por proibir o uso da tecnologia, ao menos por enquanto. E de existirem iniciativas legislativas em andamento para reduzir o uso do reconhecimento facial em Washington, Massachusetts e Nova York.

A Clearview AI conseguiu agravar ainda mais a ansiedade dos americanos sobre biometria e privacidade de dados. Ações judiciais coletivas foram movidas contra a Clearview AI por supostas violações da Lei de Privacidade da Informação Biométrica (BIPA), de Illinois, por suas práticas de coleta de imagens pelo Twitter.

O serviço da Clearview permite que agentes da lei carreguem uma foto de uma pessoa não identificada em seu banco de dados e vejam fotos publicadas por essa pessoa, juntamente com links onde foram postadas na Internet. Isso permitiria à polícia descobrir a identidade dessa pessoa, juntamente com informações importantes e altamente pessoais.

A empresa alega ter acumulado um conjunto de dados de mais de três bilhões de imagens de rosto raspando milhões de sites, incluindo sites de notícias e sites como o Facebook, YouTube e Venmo. E sua tecnologia não parece estar limitada a fotos estáticas, mas também pode procurar rostos em vídeos em sites de mídia social.

Esta semana, aliás, várias ações coletivas relacionadas ao reconhecimento facial e à BIPA geraram muita controvérsia nos EUA e colocaram empresas de setores variados, como varejo, alimentos e bebidas, hospitalidade e assistência médica, frente a frente aos riscos do tratamento de dados biométricos dos residentes no estado como parte de seus negócios ou para aumento da segurança.

Aprovada em 2008, a BIPA exige que as empresas privadas que capturam informações biométricas de indivíduos, como impressão digital, voz, varredura de retina, dados da face, etc, obtenham consentimento por escrito e divulguem como irão usar, armazenar e destruir esses dados. A lei também proíbe que as empresas lucrem com os dados biométricos coletados.

Uma queixa contra a WeWork, por exemplo, alega que a empresa rastreia pessoas em seus escritórios compartilhados usando digitalizações faciais e geometria facial de fotografias no lugar de métodos mais convencionais para garantia da segurança da construção, como crachás de identificação. A WeWork supostamente violou o BIPA por não informar adequadamente os usuários sobre a finalidade e o período de tempo durante o qual suas varreduras faciais seriam usadas e armazenadas e por não obter o consentimento por escrito. O demandante pede indenizações de US$ 5 mil para cada violação intencional ou imprudente da BIPA e US$ 1 mil para cada violação negligente.

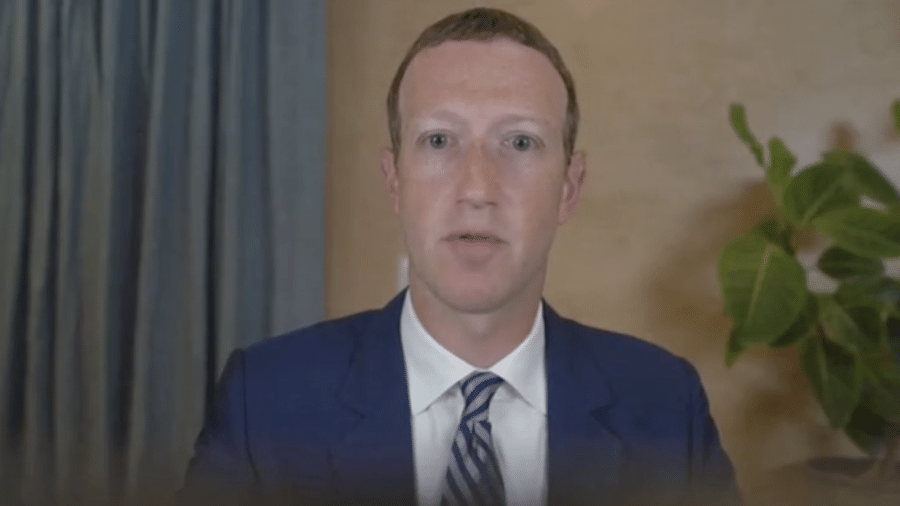

Já uma ação coletiva contra o Shutterfly, apresentada em 11 de junho de 2019, alegou violações da BIPA com base no uso da tecnologia de reconhecimento facial para sugerir "tags" nas fotografias enviadas pelos clientes. Aliás, a lei se tornou um ponto de discórdia para várias empresas de tecnologia que usam o reconhecimento facial como uma ferramenta de triagem de fotos. O Facebook pressionou por revisões legislativas da lei em várias ocasiões, sem sucesso. Agora, muitos acreditam que um acordo feito pela rede social para encerrar uma ação coletiva nesse sentido pode inspirar outras pessoas a levarem mais casos aos tribunais.

O Facebook concordou em criar um fundo de US$ 550 milhões para compensar milhões de usuários de Illinois que alegaram ter tido seus direitos violados pelo uso do reconhecimento facial, sem consentimento, para marcação de fotos. "Este acordo mostra que o BIPA não só tem dentes, mas também que eles são extremamente afiados", disse John M. Fitzgerald, sócio de Tabet DiVito & Rothstein LLC, ao site Law360.

"À medida que a coleta, o uso e o compartilhamento biométricos se tornam mais difundidos e invasivos a cada ano, torna-se mais importante que cidadãos privados possam processar sob leis como o BIPA para proteger sua privacidade", escreveu a Electronic Frontier Foundation sobre uma decisão recente da Suprema Corte de Illinois, referente à coleta da impressão digital de um adolescente sem o devido consentimento dos pais, na qual a corte declara que "uma pessoa não precisa ter sofrido danos reais além da violação de seus direitos sob a Lei" para ter ganho da causa.

E se a preocupação com o uso por empresas é grande, a com o uso pelo poder público é ainda maior. No ano passado, o Centro de Privacidade e Tecnologia de Georgetown Law divulgou um relatório sobre o software de reconhecimento facial dos departamentos de polícia da cidade de Chicago, que fica no estado de Illinois. Usando documentos do fornecedor de software DataWorks Plus, o relatório afirma que o Departamento de Polícia de Chicago e a Autoridade de Trânsito da cidade têm recursos de reconhecimento facial desde pelo menos 2016. Mas, questionado pelo WTTW News, o departamento de polícia de Chicago afirmou que a tecnologia era "raramente usada" devido à sua imprecisão. Se usa raramente, o gasto de dinheiro público com o sistema se justifica? É o que os cidadãos do estado começam a perguntar aos seus futuros representantes.

O comportamento dos cidadãos de Illinois é importante não apenas porque explica por que o uso clandestino de reconhecimento facial por empresas prejudica os interesses de privacidade das pessoas, mas também por alertar as autoridades para a aplicação da lei de que casos recentes da Suprema Corte que regulam outras formas de vigilância eletrônica têm algo a dizer sobre a face tecnologia de vigilância.

De fato, o potencial desta tecnologia para permitir que o governo identifique e rastreie de maneira generalizada qualquer pessoa (e todos) ao longo de suas vidas diárias é um dos motivos pelos quais a União Americana das Liberdades Civis (ACLU) está instando os legisladores de todo o país a interromperem o uso da aplicação da lei dos sistemas de vigilância por reconhecimento facial.

Como no Brasil, ainda não existe nos EUA uma lei federal sobre o uso da tecnologia para segurança pública. Durante as audiências realizadas pelo Comitê de Supervisão e Reforma da Câmara, um grupo bipartidário disse que pretende redigir uma legislação a respeito.

Nosso Congresso, portanto, está sintonizado com o que vem acontecendo no mundo sobre o tema. Especialmente nos EUA e na Europa. Resta saber o quanto conseguiremos levar adiante um projeto de lei específico sobre o tema.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.