Satya Nadella defende a privacidade como um direito humano

Em um painel sobre confiança e Transformação Digital em Davos, Satya Nadella, CEO da Microsoft, afirmou que é preciso haver um GDPR para o mundo, fazendo referência às leis de privacidade de dados que a Europa recentemente promulgou.

"Meu ponto de vista é que é um começo fantástico ao tratar a privacidade como um direito humano. Espero que nos Estados Unidos façamos algo semelhante e que o mundo possa convergir em um padrão comum", disse Nadella.

As pessoas devem possuir seus próprios dados, não as empresas, disse ele.

Diante do "techlash", o CEO da Microsoft defende a criação de novas normas globais sobre privacidade, dados e, principalmente, Inteligência Artificial.

Está certo. A tão badalada IA também tem um pé na vilania. Ela pode causar sérios danos, por exemplo, quando os algoritmos começam a refletir vieses humanos nos conjuntos de dados que as organizações coletam, processam e usam em seus produtos e serviços. Os efeitos desses vieses podem ser complicados, uma vez que os próprios algoritmos continuam a "aprender" com os dados que geram.

A IA também pode ser prejudicial ao comandar decisões automatizadas para lá de herméticas. Como os sistemas inteligentes usam uma quantidade grande de dados e muitas regras para processá-las, muitas vezes é impossível entender como o mecanismo de Inteligência Artificial chega a uma conclusão.

Para lidar com essas questões, a autorregulação já não é suficiente, alerta Satya Nadella. Vale lembrar que a Microsoft é uma das integrantes do consórcio Partnership on AI, que reúne várias gigantes em torno desse compromisso de autorregulamentação. Por isso, tem o seu próprio regulamento de uso ético da IA.

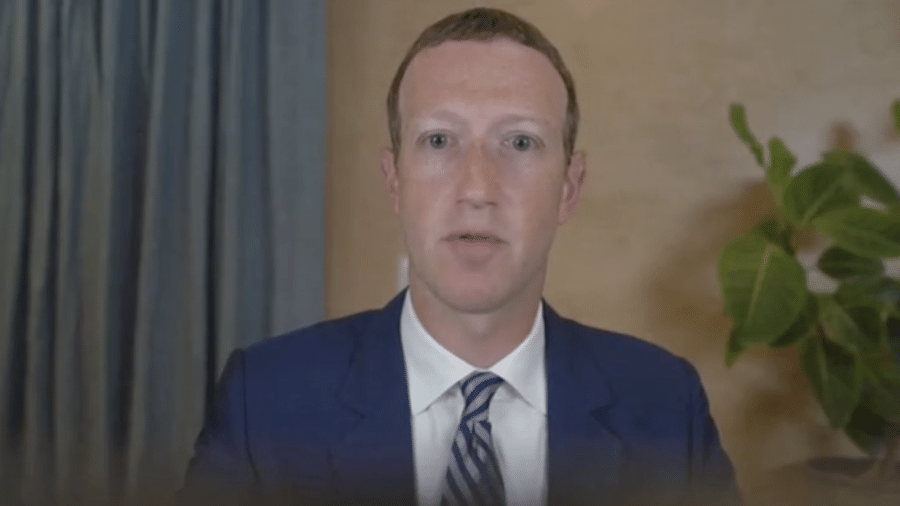

Outro membro do consórcio, o Google, também publicou em meado de dezembro as suas práticas de IA responsável. Seis meses antes, já havia anunciado seus AI Principles. Esta semana foi a vez do Facebook anunciar o lançamento de um instituto de pesquisa dedicado à ética da Inteligência Artificial, em parceria com a Universidade Técnica de Munique.

"No mercado, não há discriminação entre o uso certo e o uso errado … Congratulamo-nos com qualquer regulamento que ajude o mercado a fazê-lo".

Outra preocupação de CEO da Microsoft é com o uso crescente do reconhecimento facial.

"É uma peça de tecnologia que será democratizada, e que será predominante. Posso listar 10 usos que são muito virtuosos e importantes e que podem melhorar a vida humana, e 10 usos que causariam problemas", disse ele.

Em seu site, a Microsoft lista principalmente a aplicações benéficas da tecnologia. Por exemplo:

"A polícia de Nova Delhi testou recentemente a tecnologia de reconhecimento facial e identificou quase 3 mil crianças desaparecidas em quatro dias. Historiadores nos Estados Unidos usaram a tecnologia para identificar os retratos de soldados desconhecidos em fotografias da Guerra Civil tiradas na década de 1860. Pesquisadores usaram com sucesso o reconhecimento facial software para diagnosticar uma doença genética rara em africanos, asiáticos e latino-americanos".

O lado negativo está no site do Kaspersky Lab, que publicou recentemente um extenso artigo a respeito, mencionando exemplos de vigilância em massa, invasão de privacidade e preconceito.

O artigo da Kaspersky começa nos lembrando do fato de que podemos mudar nossos nomes e pseudônimos. Editar ou deletar as contas de mídias sociais. Mas não podemos alterar o nosso rosto com a mesma facilidade.

Um dos casos citados é o do sistemas do serviço de inteligência dos Estados Unidos.

"O FBI mantém legalmente a próxima geração do sistema de identificação fotográfica interestadual (NGI-IPS), uma base de dados que armazena imagens de pessoas acusadas e condenadas por delitos.

Em maio, o governo americano auditou o FBI e descobriu que a base de dados de 412 milhões de imagens também possuía fotos de pessoas que nunca foram alvo de investigação criminal. A agência até tem uma divisão responsável por reconhecimento facial, o Serviço de Avaliação, Comparação e Análise Facial (FACE).

O que ocorreu é que representantes do FBI obtiveram fotos de carteiras de motorista, passaportes e candidatura de visto por meio de acordos com Estados, além das imagens de suspeitos de crimes e condenados. A base de dados também inclui informações de aproximadamente 100 milhões de cidadãos estrangeiros.

(…) Tecnologias de reconhecimento facial são ainda muito jovens e imperfeitas. Por isso, o sistema do FBI não é exceção: possui parcialidades raciais e possui uma precisão máxima de 80-85%. Ao mesmo tempo, o FBI encobriu deliberadamente a escala do uso de reconhecimento facial, contrariando os requisitos do Relatório de Impacto à Privacidade."

O artigo da Kaspersky não livra nem mesmo a cara da própria Microsoft.

"Empresas possuem bases de dados ainda maiores que a do FBI. Redes sociais lideram esse quadro: Facebook, Instagram (que pertence ao Facebook), Google (com o Google+) e outras. A maioria possui suas próprias soluções de reconhecimento facial, que passam por melhorias e desenvolvimento constantes.

A Microsoft trabalha agora em uma tecnologia similar para o aplicativo FamilyNotes, que auxiliará o software a diferenciar um usuário do outro por meio de uma câmera embutida no celular ou no tablet. A Microsoft desenvolve o sistema operacional mais popular do mundo, esse aplicativo irá suprir a base de dados de rostos da empresa."

No fim das contas, todo mundo coleta faces: governos, empresas e corporações, até mesmo gente comum, ressalta a Kaspesrky. Da mesma forma, todo mundo pode usar sistemas de reconhecimento facial, independente da natureza do uso. Então, é preciso agir o quanto antes para ampliar a transparência em torno da sua aplicação, bem como de outras tecnologias decorrentes dos avanços da Inteligência Artificial. Parar de falar em ética da IA e começar a agir, como pregaram vários convidados do 49º Fórum Econômico Mundial, esta semana, em Davos.

Com as máquinas aptas a aprender, as decisões tomadas por elas podem trazer consequências significativas. E, de fato, a única forma de garantir que não criemos um monstro que possa se voltar contra nós é incorporar salvaguardas éticas na arquitetura da IA que estamos desenvolvendo hoje.

A ver.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.